Содержание статьи

- /01 Базовый принцип работы Google ботов

- /02 Googlebot и его влияние на SEO

- /03 Googlebot-Image: роль в поиске

- /04 Googlebot-Video: как работает с видео

- /05 Googlebot-News: когда он нужен бизнесу

- /06 Смежные боты Google

- /07 GoogleOther, Google-Extended и Google-CloudVertexBot

- /08 Что реально влияет на то, как часто Google сканирует сайт

- /09 Как проверять, что видит Google

- /10 Как бизнесу использовать это на практике

Для бизнесов, которые активно продвигаются в сети и имеют сайты, поисковые боты Google — это не техническая мелочь, а один из ключевых факторов, влияющих на видимость в поиске. Именно они определяют, как быстро Google находит новые страницы, насколько корректно читает контент и может ли правильно оценить его для дальнейшего ранжирования.

В статье рассмотрим основные виды поисковых ботов Google, как Google сканирует страницы, какие сигналы учитывает, какие технические ошибки мешают индексации и что нужно сделать, чтобы сайт был понятным и полезным для поисковой системы.

Базовый принцип работы Google ботов

Google находит страницы несколькими путями:

- через ссылки с других страниц;

- через карту сайта sitemap;

- через уже известные Google URL.

Sitemap помогает поисковой системе быстрее обнаруживать важные страницы, видео и другие файлы на сайте, а также дает дополнительные сигналы о том, когда страница обновлялась и какие есть альтернативные языковые версии. Но sitemap не гарантирует индексацию — он лишь облегчает сканирование и помогает Google лучше понять структуру ресурса. Например, компания может добавить страницу в sitemap, но, если она не имеет внутренних ссылок или выглядит малоценной (слабый контент, дублирование), Google может ее просканировать, но не добавить в индекс.

После того как страница найдена, Google сканирует ее, обрабатывает содержимое и уже потом решает, добавлять ли ее в индекс и как трактовать ее при ранжировании. Для больших или часто обновляемых сайтов важным становится crawl budget (ресурс сканирования) — то есть объем и приоритет URL, которые Google может и хочет просканировать. Если сайт имеет низкий спрос на страницы или сложную техническую структуру, Google может сканировать его реже.

Отдельно стоит рассматривать роль robots.txt. Этот файл управляет доступом к сканированию, но не является способом скрыть страницу из результатов поиска. Если нужно не допустить страницу в Google Search, корректные инструменты – noindex или password protection. Даже если URL заблокирован в robots.txt, он все равно может попасть в результаты поиска, если на него ведут другие страницы.

Googlebot и его влияние на SEO

Googlebot — это основной веб-краулер Google Search. Именно он собирает информацию о страницах, чтобы Google мог их индексировать и использовать в поиске. В современной модели Google для большинства сайтов главным является именно смартфонный краулер, а значит поисковая система ориентируется прежде всего на мобильную версию контента.

Google использует mobile-first indexing. Для индексации и ранжирования берется мобильная версия сайта, просканированная смартфон-агентом. Это означает, что мобильная версия должна содержать то же содержание, что и десктопная, и быть технически доступной для сканирования. Если важный контент на мобильной версии отсутствует или скрыт, Google может оценить страницу неполноценно. Например, если на мобильной версии скрыта часть описания товара или характеристики, которые есть на десктопе, Google может не учесть этот контент при индексации. В результате страница ранжируется хуже, чем ожидает бизнес.

Скорость загрузки, структура страниц, внутренняя перелинковка и отсутствие технических барьеров влияют на то, насколько эффективно Googlebot может обходить сайт. Если важные страницы глубоко спрятаны в архитектуре ресурса или сайт перегружен малоценными URL, Google расходует ресурсы менее рационально. Именно поэтому техническая чистота сайта напрямую связана с органической видимостью.

Начните SEO с технического аудита

Закажите технический аудит сайта в WEDEX, чтобы проверить скорость загрузки, доступность страниц для Googlebot и устранить проблемы, которые негативно влияют на видимость в поиске.

Поэтому стоит обратить внимание: если сайт удобно читается для пользователя на смартфоне, правильно открывается для Googlebot и не имеет технических блокировок для ключевых страниц, он значительно лучше подготовлен к стабильному присутствию в поиске.

Googlebot-Image: роль в поиске

Googlebot-Image отвечает не только за Google Images. Его сканирование влияет на то, как изображения, логотипы и фавиконы могут показываться в Google Search, а также на видимость в Discover и в связанных видео- и поисковых поверхностях. Получается, что визуальный контент работает не только как элемент дизайна, но и как отдельный источник поискового трафика.

Чтобы изображения приносили пользу SEO, они должны быть понятными для поисковика. Важны:

- название файла;

- alt-текст;

- подпись;

- контекст страницы, на которой размещено изображение.

Именно эти сигналы помогают Google лучше понять, что изображено на файле и как он связан с темой страницы.

Если картинка выложена без содержательного описания, ее шанс работать на органическую видимость уменьшается.

Например, если изображение товара имеет название вроде IMG_1234.jpg и не содержит alt-текста, Google не получает сигнала о его содержании. Если же файл назван «wooden-dining-table.jpg» и имеет описание, он может появляться в поиске по соответствующим запросам.

Для сайтов это особенно важно на страницах услуг, в карточках товаров, кейсах и статьях, где изображение часто усиливает основное содержание. Если Google не может корректно просканировать изображение, сайт теряет часть потенциальной видимости в поиске и смежных поверхностях.

Googlebot-Video: как работает с видео

Googlebot-Video работает с видеосигналами и влияет на функции, связанные с видео, Google Search и другие продукты, зависящие от видео. Другими словами, видеоконтент может давать дополнительную видимость в поиске, но только тогда, когда Google может технически его прочитать и понять.

Имеют значение:

- метаданные;

- миниатюра;

- субтитры;

- транскрипция;

- общая техническая доступность ролика.

Google также отмечает, что видео нельзя нормально индексировать без сканирования, поэтому ограничение доступа к видеофайлам или их неправильное размещение могут снизить эффективность в поиске. Для сайтов, где видео объясняет продукт, услугу или процесс, это прямо влияет на SEO-результат. Например, если видео встроено через сторонний плеер без структурированных данных и без текстового описания на странице, Google может не распознать его как основной контент. В таком случае страница не получает дополнительной видимости в видеоформатах.

Следовательно, видео должно быть не просто опубликовано, а оформлено так, чтобы поисковая система могла увидеть его содержание и контекст. Если страница с роликом создана технически корректно, она получает больше шансов на дополнительную видимость в поисковых поверхностях Google.

Googlebot-News: когда он нужен бизнесу

Googlebot-News касается именно Google News, а не всего Google Search в целом. Google отмечает, что этот агент пользователя используется для того, чтобы определенные страницы могли попадать в Google News, включая news.google.com и приложение Google News.

Поэтому этот бот прежде всего важен для новостных и медийных сайтов. Для бизнеса он становится актуальным тогда, когда компания имеет редакционный блог, новостной раздел или регулярно публикует оперативные материалы, где скорость выхода контента имеет значение. В таких случаях Googlebot-News помогает лучше управлять тем, какие материалы могут быть показаны в новостной вертикали.

Для новостного контента особенно важны:

- четкая структура страницы;

- понятный заголовок;

- своевременная публикация.

Если материалы оформлены аккуратно и доступны для сканирования, Google получает больше оснований корректно обработать их для новостного продукта.

Смежные боты Google

Помимо основного Googlebot, у Google есть отдельная группа специализированных ботов, которые работают не для классического поиска, а для других продуктов экосистемы. AdsBot-Google и AdsBot-Google-Mobile используются Google Ads для проверки качества веб-страниц объявлений, причем общее правило в robots.txt для них не применяется.

Mediapartners-Google связан с Google AdSense и посещает сайты-участники программы, чтобы помогать показывать релевантную рекламу. Это важно понимать, чтобы не смешивать SEO-логику с рекламной или монетизационной.

Storebot-Google касается всех поверхностей Google Shopping, включая вкладку Shopping в Google Search. А Google-InspectionTool работает только для Search testing tools, в частности Rich Result Test и URL inspection в Search Console, и не влияет на Google Search или другие продукты.

Поэтому получается, что не каждый бот Google влияет именно на органическую выдачу, хотя каждый из них может быть важным для отдельного канала трафика.

GoogleOther, Google-Extended и Google-CloudVertexBot

GoogleOther — это универсальный краулер Google, который может использоваться различными командами для доступа к публично доступному контенту, например для одноразовых обходов или исследований. Google прямо отмечает, что этот бот не влияет на Google Search и не привязан к отдельному продукту. Его варианты GoogleOther-Image и GoogleOther-Video работают соответственно с изображениями и видео, но тоже не меняют поисковую видимость сайта в Search.

Google-CloudVertexBot используется для crawls, которые инициирует владелец сайта при построении Vertex AI Agents, и также не имеет влияния на Google Search. Google-Extended — это отдельный продуктовый токен, с помощью которого владельцы сайтов могут управлять тем, может ли контент, который Google сканирует, использоваться для обучения будущих версий моделей Gemini и использования в качестве источника проверенных данных (grounding). В то же время Google отдельно подчеркивает, что Google-Extended не влияет на включение сайта в Google Search и не является сигналом ранжирования.

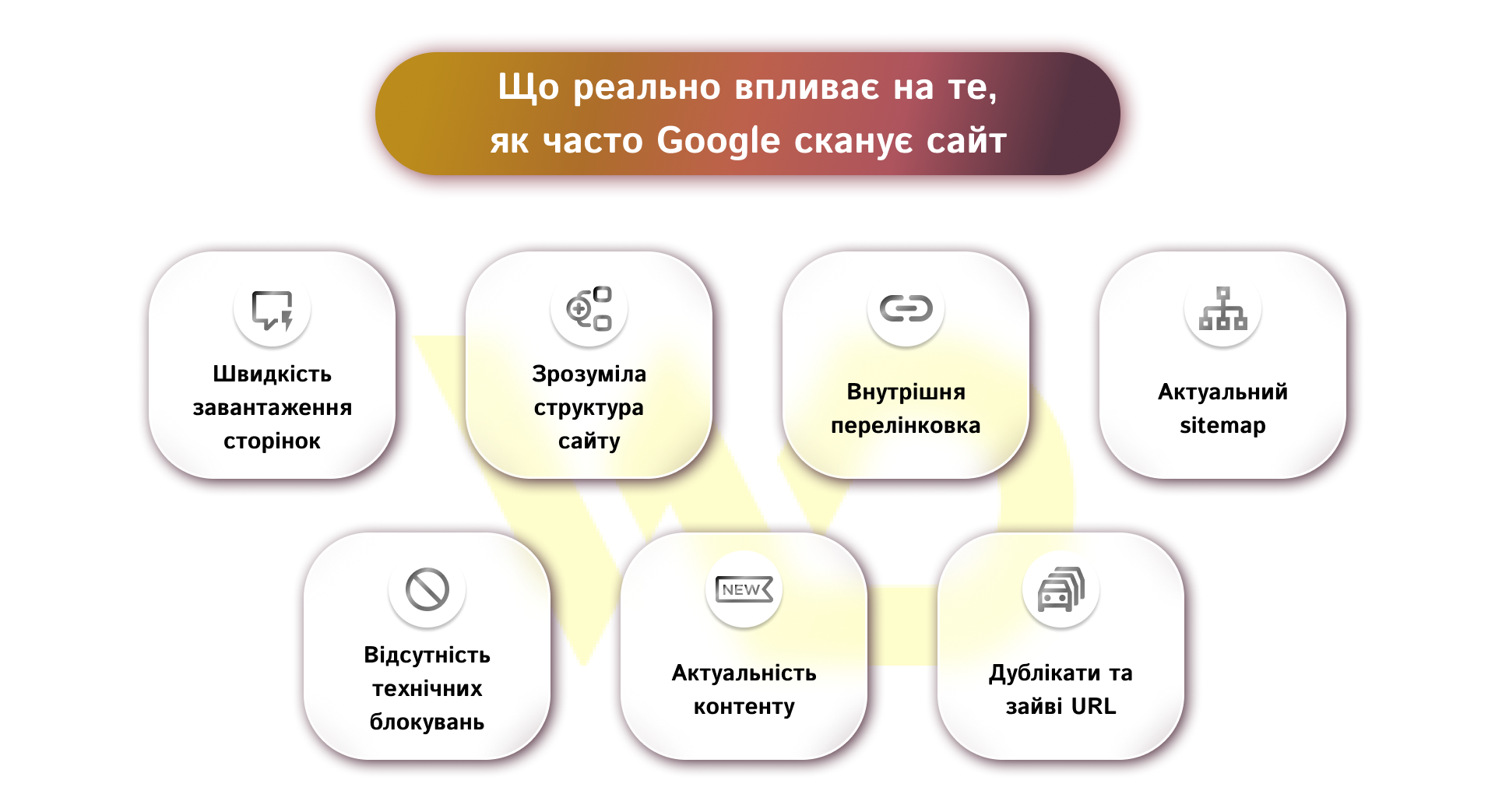

Что реально влияет на то, как часто Google сканирует сайт

Google не сканирует все страницы одинаково — он приоритизирует те, которые считает ценными. Частота сканирования зависит не от одного параметра, а от совокупности технических и контентных сигналов.

Разберем главные факторы, которые имеют значение для бизнес-сайта.

- Скорость загрузки страниц. Чем быстрее открывается сайт, тем легче Googlebot обрабатывать его без лишних затрат ресурсов. Медленные страницы могут затруднять сканирование и снижать эффективность обхода.

- Понятная структура сайта. Если важные разделы размещены логично и доступны в несколько кликов, Googlebot проще находить и обновлять нужные URL. Запутанная архитектура, наоборот, заставляет робот тратить больше времени на второстепенные страницы.

- Внутренняя перелинковка. Ссылки между страницами показывают Google, какие URL являются приоритетными. Сильные внутренние связи помогают быстрее находить новый или обновленный контент и лучше распределять внимание робота между страницами.

- Актуальный sitemap. Карта сайта не гарантирует индексацию, но помогает Google быстрее находить важные URL, особенно на больших или часто обновляемых сайтах. Если sitemap устаревший или содержит лишние страницы, его польза уменьшается.

- Отсутствие технических блокировок. Если важные страницы, стили, скрипты или изображения закрыты от сканирования без надобности, Google может хуже понять сайт и тратить crawl budget неэффективно. Robots.txt управляет сканированием, но не заменяет noindex, когда нужно убрать страницу из поиска.

- Актуальность контента. Сайты с частыми обновлениями и реальной потребностью в повторном обходе Google может сканировать активнее. Если контент долго не меняется или не пользуется спросом, частота обхода может быть ниже.

- Дубликаты и лишние URL. Параметрические страницы, технические копии и другие малоценные URL создают шум и отвлекают Googlebot от важных страниц. Чем больше такого балласта, тем менее эффективно используется crawl budget. Например, интернет-магазин с большим количеством фильтров может генерировать тысячи URL с параметрами (цена, цвет, размер), которые не имеют отдельной SEO-ценности. В результате Googlebot тратит crawl budget на эти страницы, вместо того чтобы чаще сканировать ключевые категории или новые товары.

Чем чище техническая структура сайта и чем понятнее он построен для Googlebot, тем стабильнее он сканируется и тем меньше шансов потерять органическую видимость из-за технических мелочей.

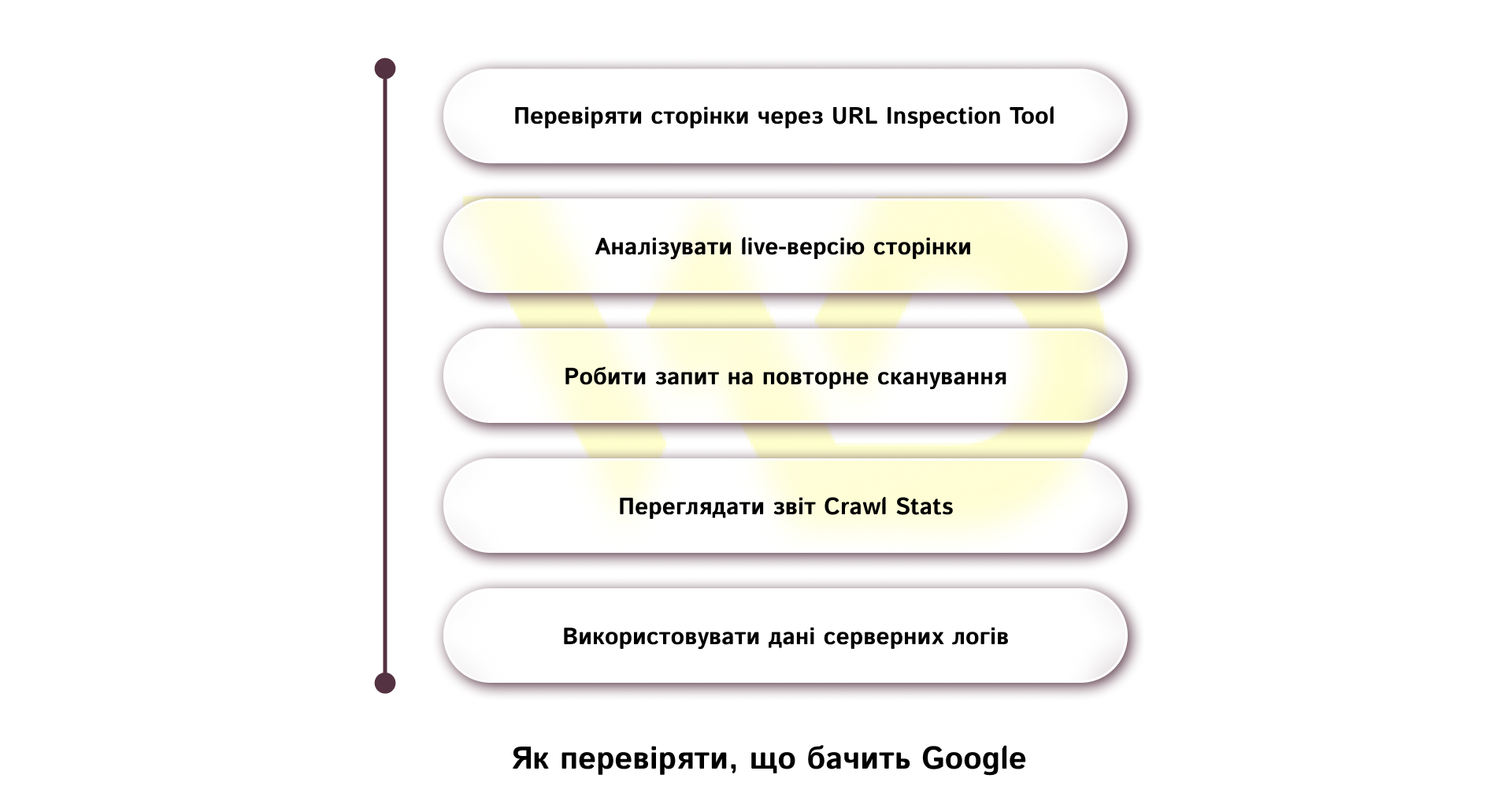

Как проверять, что видит Google

Самый удобный способ понять, как именно Google обрабатывает страницы сайта, — использовать Google Search Console. Именно здесь собраны основные инструменты, которые дают доступ к данным о сканировании, индексации и отображении страниц в поиске.

Ключевые действия, которые стоит выполнять регулярно:

Проверять страницы через URL Inspection Tool

Инструмент показывает, есть ли страница в индексе, когда она последний раз сканировалась и как Google ее видит. Это позволяет быстро понять причину проблем, если страница не появляется в поиске или отображается некорректно. Например, если страница есть на сайте, но не появляется в поиске, через URL Inspection можно увидеть, что она не индексируется из-за технической ошибки или отсутствия сигналов качества.

Анализировать live-версию страницы

Функция проверки в реальном времени помогает увидеть, как Googlebot обрабатывает страницу именно сейчас, включая доступность ресурсов, скриптов и медиа. Это особенно важно после внесения изменений.

Делать запрос на повторное сканирование

Если страница обновлена или создана недавно, можно подать запрос на повторный crawl. При этом важно учитывать, что это не гарантирует мгновенную индексацию, процесс может занять время.

Просматривать отчет Crawl Stats

Этот раздел показывает общую динамику сканирования: количество запросов, объем загруженных данных и время ответа сервера. Так можно обнаружить технические проблемы или резкие изменения в поведении Googlebot.

Использовать данные серверных логов

Для более глубокого анализа стоит обращаться к логам сервера, где видны реальные запросы Googlebot. Это помогает понять, какие страницы сканируются чаще всего, а какие игнорируются.

В комплексе эти инструменты дают полное представление о том, как Google взаимодействует с сайтом: от первого обхода до попадания страницы в индекс и ее дальнейшего отображения в поиске.

Как бизнесу использовать это на практике

Стратегия должна быть простой и структурированной:

- важные страницы не следует блокировать в robots.txt, если они должны работать в поиске, иначе Google не сможет их просканировать, что усложнит индексацию и обновление контента;

- если страницу нужно убрать из выдачи, для этого используют noindex или ограничение доступа, ведь robots.txt лишь запрещает сканирование, но не гарантирует, что страница не появится в поиске;

- мобильная версия должна быть полноценной, а не упрощенной до потери содержания — именно она используется для индексации, поэтому отсутствие контента или элементов влияет на оценку страницы;

- sitemap нужно поддерживать в актуальном состоянии, потому что он помогает Google быстрее находить новые и обновленные страницы, особенно на больших сайтах;

- Search Console стоит проверять регулярно, а не только после падения трафика; это позволяет вовремя замечать проблемы со сканированием, индексацией и техническим состоянием сайта.

Так что владельцы бизнеса должны помнить: чем меньше технического шума и чем четче построена логика сайта, тем стабильнее он сканируется, быстрее обновляется в индексе и надежнее сохраняет органическую видимость.

27/04/2026

27/04/2026  1007

1007