Зміст статті

- /01 Базовий принцип роботи Google ботів

- /02 Googlebot і його вплив на SEO

- /03 Googlebot-Image: роль у пошуку

- /04 Googlebot-Video: як працює з відео

- /05 Googlebot-News: коли він потрібен бізнесу

- /06 Суміжні боти Google

- /07 GoogleOther, Google-Extended і Google-CloudVertexBot

- /08 Що реально впливає на те, як часто Google сканує сайт

- /09 Як перевіряти, що бачить Google

- /10 Як бізнесу використати це на практиці

Для бізнесів, які активно просуваються у мережі та мають сайти, пошукові боти Google — це не технічна дрібниця, а один із ключових факторів, що впливають на видимість у пошуку. Саме вони визначають, як швидко Google знаходить нові сторінки, наскільки коректно читає контент і чи може правильно оцінити його для подальшого ранжування.

У статті розглянемо основні види пошукових ботів Google, як Google сканує сторінки, які сигнали враховує, які технічні помилки заважають індексації і що потрібно зробити, щоб сайт був зрозумілим і корисним для пошукової системи.

Базовий принцип роботи Google ботів

Google знаходить сторінки кількома шляхами:

- через посилання з інших сторінок;

- через карту сайту sitemap;

- через вже відомі Google URL.

Sitemap допомагає пошуковій системі швидше виявляти важливі сторінки, відео та інші файли на сайті, а також дає додаткові сигнали про те, коли сторінка оновлювалася і які є альтернативні мовні версії. Але sitemap не гарантує індексацію — він лише полегшує сканування та допомагає Google краще зрозуміти структуру ресурсу. Наприклад, компанія може додати сторінку в sitemap, але якщо вона не має внутрішніх посилань або виглядає малоцінною (слабкий контент, дублювання), Google може її просканувати, але не додати до індексу.

Після того як сторінку знайдено, Google сканує її, обробляє вміст і вже потім вирішує, чи додавати її до індексу та як трактувати її під час ранжування. Для великих або часто оновлюваних сайтів важливим стає crawl budget (ресурс сканування) — тобто обсяг і пріоритет URL, які Google може і хоче просканувати. Якщо сайт має низький попит на сторінки або складну технічну структуру, Google може сканувати його рідше.

Окремо варто розглядати роль robots.txt. Цей файл керує доступом до сканування, але не є способом приховати сторінку з результатів пошуку. Якщо потрібно не допустити сторінку в Google Search, коректні інструменти — noindex або password protection. Навіть якщо URL заблокований у robots.txt, він усе одно може потрапити до результатів пошуку, якщо на нього ведуть інші сторінки.

Googlebot і його вплив на SEO

Googlebot — це основний веб-краулер Google Search. Саме він збирає інформацію про сторінки, щоб Google міг їх індексувати та використовувати в пошуку. У сучасній моделі Google для більшості сайтів головним є саме смартфонний краулер, а отже пошукова система орієнтується насамперед на мобільну версію контенту.

Google використовує mobile-first indexing. Для індексації та ранжування береться мобільна версія сайту, просканована смартфон-агентом. Це означає, що мобільна версія має містити той самий зміст, що й десктопна, і бути технічно доступною для сканування. Якщо важливий контент на мобільній версії відсутній або прихований, Google може оцінити сторінку неповноцінно. Наприклад, якщо на мобільній версії приховано частину опису товару або характеристики, які є на десктопі, Google може не врахувати цей контент під час індексації. У результаті сторінка ранжується гірше, ніж очікує бізнес.

Швидкість завантаження, структура сторінок, внутрішнє перелінкування та відсутність технічних бар’єрів впливають на те, наскільки ефективно Googlebot може обходити сайт. Якщо важливі сторінки глибоко заховані в архітектурі ресурсу або сайт перевантажений малоцінними URL, Google витрачає ресурси менш раціонально. Саме тому технічна чистота сайту напряму пов’язана з органічною видимістю.

Почніть SEO з технічного аудиту

Замовте технічний аудит сайту у WEDEX, щоб перевірити швидкість завантаження, доступність сторінок для Googlebot та усунути проблеми, які негативно впливають на видимість у пошуку.

Тому варто звернути увагу: якщо сайт зручно читається для користувача на смартфоні, правильно відкривається для Googlebot і не має технічних блокувань для ключових сторінок, він значно краще підготовлений до стабільної присутності в пошуку.

Googlebot-Image: роль у пошуку

Googlebot-Image відповідає не лише за Google Images. Його сканування впливає на те, як зображення, логотипи та фавікони можуть показуватися в Google Search, а також на видимість у Discover і в пов’язаних відео- та пошукових поверхнях. Тож виходить, що візуальний контент працює не тільки як елемент дизайну, а й як окреме джерело пошукового трафіку.

Щоб зображення приносили користь SEO, вони мають бути зрозумілими для пошуковика. Важливі:

- назва файлу;

- alt-текст;

- підпис;

- контекст сторінки, на якій розміщене зображення.

Саме ці сигнали допомагають Google краще зрозуміти, що зображено на файлі та як він пов’язаний із темою сторінки.

Якщо картинка викладена без змістовного опису, її шанс працювати на органічну видимість зменшується.

Наприклад, якщо зображення товару має назву на кшталт IMG_1234.jpg і не містить alt-тексту, Google не отримує сигналу про його зміст. Якщо ж файл названий «wooden-dining-table.jpg» і має опис, він може з’являтися в пошуку за відповідними запитами.

Для сайтів це особливо важливо на сторінках послуг, у картках товарів, кейсах і статтях, де зображення часто підсилює основний зміст. Якщо Google не може коректно просканувати зображення, сайт втрачає частину потенційної видимості в пошуку та суміжних поверхнях.

Googlebot-Video: як працює з відео

Googlebot-Video працює з відеосигналами і впливає на функції, пов’язані з відео, Google Search та інші продукти, що залежать від відео. Іншими словами, відеоконтент може давати додаткову видимість у пошуку, але лише тоді, коли Google може технічно його прочитати та зрозуміти.

Мають значення:

- метадані;

- мініатюра;

- субтитри;

- транскрипція;

- загальна технічна доступність ролика.

Google також наголошує, що відео не можна нормально індексувати без сканування, тому обмеження доступу до відеофайлів або їх неправильне розміщення можуть знизити ефективність у пошуку. Для сайтів, де відео пояснює продукт, послугу або процес, це прямо впливає на SEO-результат. Наприклад, якщо відео вбудоване через сторонній плеєр без структурованих даних і без текстового опису на сторінці, Google може не розпізнати його як основний контент. У такому випадку сторінка не отримує додаткової видимості у відеоформатах.

Отже, відео має бути не просто опубліковане, а оформлене так, щоб пошукова система могла побачити його зміст і контекст. Якщо сторінка з роликом створена технічно коректно, вона отримує більше шансів на додаткову видимість у пошукових поверхнях Google.

Googlebot-News: коли він потрібен бізнесу

Googlebot-News стосується саме Google News, а не всього Google Search загалом. Google зазначає, що цей агент користувача використовується для того, щоб певні сторінки могли потрапляти в Google News, включно з news.google.com і застосунком Google News.

Тому цей бот насамперед важливий для новинних і медійних сайтів. Для бізнесу він стає актуальним тоді, коли компанія має редакційний блог, новинний розділ або регулярно публікує оперативні матеріали, де швидкість виходу контенту має значення. У таких випадках Googlebot-News допомагає краще керувати тим, які матеріали можуть бути показані в новинній вертикалі.

Для новинного контенту особливо важливі:

- чітка структура сторінки;

- зрозумілий заголовок;

- своєчасна публікація.

Якщо матеріали оформлені акуратно та доступні для сканування, Google отримує більше підстав коректно обробити їх для новинного продукту.

Суміжні боти Google

Крім основного Googlebot, у Google є окрема група спеціалізованих ботів, які працюють не для класичного пошуку, а для інших продуктів екосистеми. AdsBot-Google і AdsBot-Google-Mobile використовуються Google Ads для перевірки якості веб-сторінок оголошень, причому загальне правило у robots.txt для них не застосовується.

Mediapartners-Google пов’язаний із Google AdSense і відвідує сайти-учасники програми, щоб допомагати показувати релевантну рекламу. Це важливо розуміти, щоб не змішувати SEO-логіку з рекламною чи монетизаційною.

Storebot-Google стосується всіх поверхонь Google Shopping, включно з вкладкою Shopping у Google Search. А Google-InspectionTool працює лише для Search testing tools, зокрема Rich Result Test і URL inspection у Search Console, і не впливає на Google Search або інші продукти.

Тож виходить, що не кожен бот Google впливає саме на органічну видачу, хоча кожен із них може бути важливим для окремого каналу трафіку.

GoogleOther, Google-Extended і Google-CloudVertexBot

GoogleOther — це універсальний краулер Google, який може використовуватися різними командами для доступу до публічно доступного контенту, наприклад для одноразових обходів або досліджень. Google прямо зазначає, що цей бот не впливає на Google Search і не прив’язаний до окремого продукту. Його варіанти GoogleOther-Image і GoogleOther-Video працюють відповідно з зображеннями та відео, але теж не змінюють пошукову видимість сайту в Search.

Google-CloudVertexBot використовується для crawls, які ініціює власник сайту під час побудови Vertex AI Agents, і також не має впливу на Google Search. Google-Extended — це окремий продуктовий токен, за допомогою якого власники сайтів можуть керувати тим, чи може контент, який Google сканує, використовуватися для навчання майбутніх версій моделей Gemini та використання як джерела перевірених даних (grounding). Водночас Google окремо підкреслює, що Google-Extended не впливає на включення сайту в Google Search і не є сигналом ранжування.

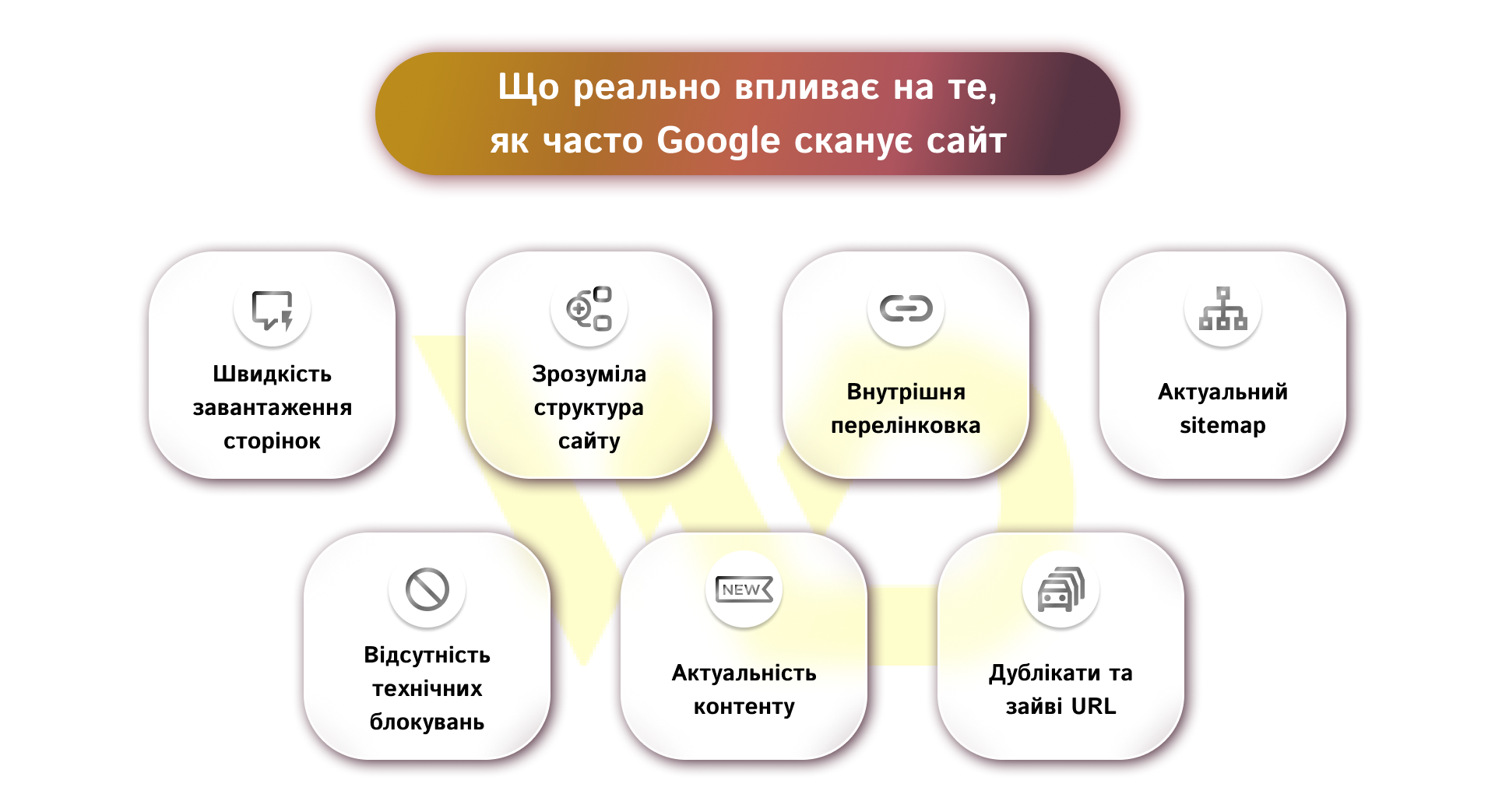

Що реально впливає на те, як часто Google сканує сайт

Google не сканує всі сторінки однаково — він пріоритизує ті, які вважає цінними. Частота сканування залежить не від одного параметра, а від сукупності технічних і контентних сигналів.

Розберемо головні чинники, які мають значення для бізнес-сайту.

- Швидкість завантаження сторінок. Чим швидше відкривається сайт, тим легше Googlebot обробляти його без зайвих витрат ресурсів. Повільні сторінки можуть ускладнювати сканування і знижувати ефективність обходу.

- Зрозуміла структура сайту. Якщо важливі розділи розміщені логічно і доступні за кілька кліків, Googlebot простіше знаходити та оновлювати потрібні URL. Заплутана архітектура, навпаки, змушує робот витрачати більше часу на другорядні сторінки.

- Внутрішня перелінковка. Посилання між сторінками показують Google, які URL є пріоритетними. Сильні внутрішні зв’язки допомагають швидше знаходити новий або оновлений контент і краще розподіляти увагу робота між сторінками.

- Актуальний sitemap. Карта сайту не гарантує індексацію, але допомагає Google швидше знаходити важливі URL, особливо на великих або часто оновлюваних сайтах. Якщо sitemap застарілий або містить зайві сторінки, його користь зменшується.

- Відсутність технічних блокувань. Якщо важливі сторінки, стилі, скрипти або зображення закриті від сканування без потреби, Google може гірше зрозуміти сайт і витрачати crawl budget неефективно. Robots.txt керує скануванням, але не замінює noindex, коли потрібно прибрати сторінку з пошуку.

- Актуальність контенту. Сайти з частими оновленнями та реальною потребою в повторному обході Google може сканувати активніше. Якщо контент довго не змінюється або не має попиту, частота обходу може бути нижчою.

- Дублікати та зайві URL. Параметричні сторінки, технічні копії та інші малоцінні URL створюють шум і відволікають Googlebot від важливих сторінок. Чим більше такого баласту, тим менш ефективно використовується crawl budget. Наприклад, інтернет-магазин із великою кількістю фільтрів може генерувати тисячі URL із параметрами (ціна, колір, розмір), які не мають окремої SEO-цінності. У результаті Googlebot витрачає crawl budget на ці сторінки, замість того щоб частіше сканувати ключові категорії або нові товари.

Чим чистіша технічна структура сайту і чим зрозуміліше він побудований для Googlebot, тим стабільніше він сканується та тим менше шансів втратити органічну видимість через технічні дрібниці.

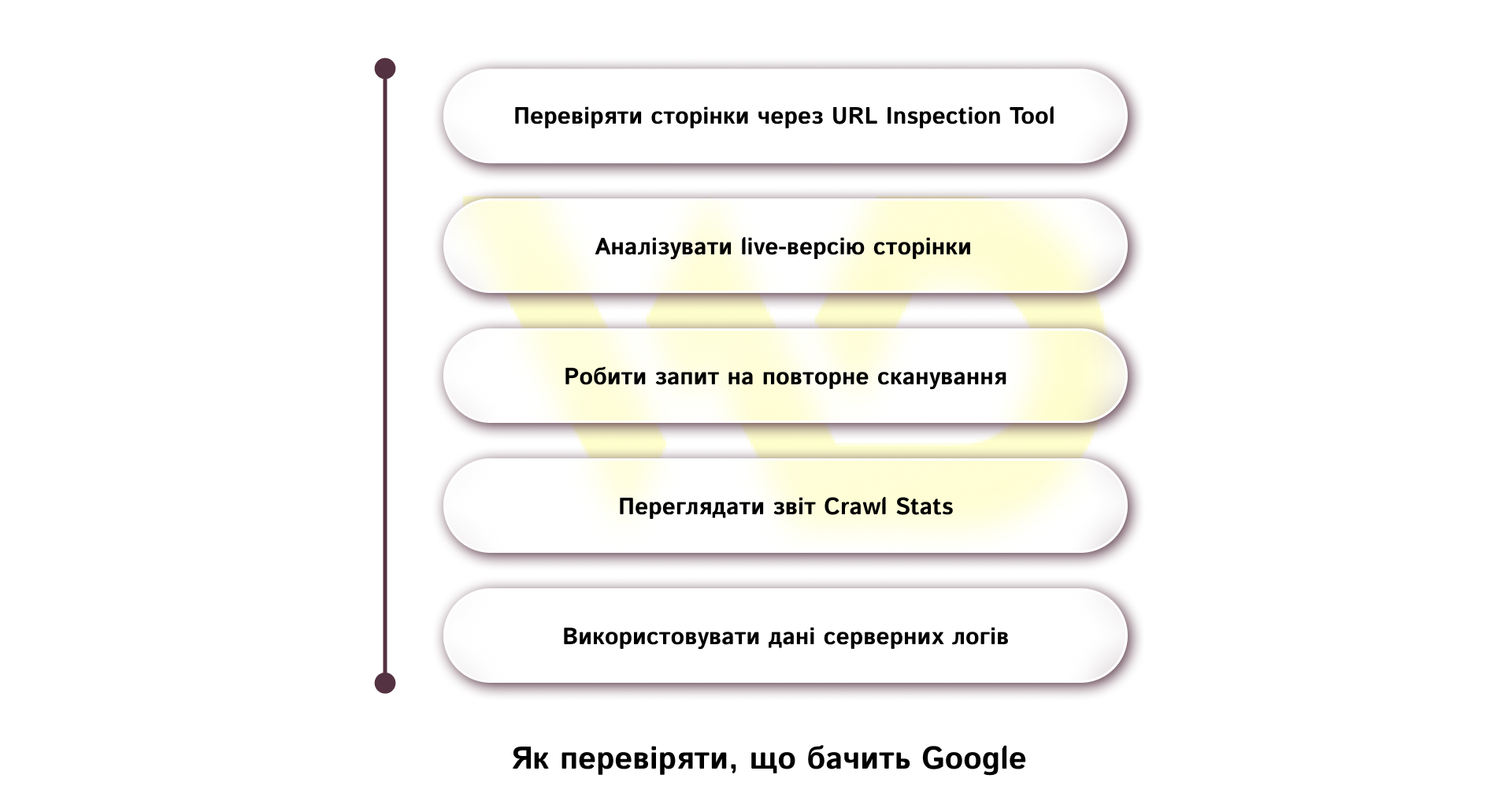

Як перевіряти, що бачить Google

Найзручніший спосіб зрозуміти, як саме Google обробляє сторінки сайту, — використовувати Google Search Console. Саме тут зібрані основні інструменти, які дають доступ до даних про сканування, індексацію та відображення сторінок у пошуку.

Ключові дії, які варто виконувати регулярно:

Перевіряти сторінки через URL Inspection Tool

Інструмент показує, чи є сторінка в індексі, коли вона востаннє сканувалася та як Google її бачить. Це дозволяє швидко зрозуміти причину проблем, якщо сторінка не з’являється в пошуку або відображається некоректно. Наприклад, якщо сторінка є на сайті, але не з’являється в пошуку, через URL Inspection можна побачити, що вона не індексується через технічну помилку або відсутність сигналів якості.

Аналізувати live-версію сторінки

Функція перевірки в реальному часі допомагає побачити, як Googlebot обробляє сторінку саме зараз, включно з доступністю ресурсів, скриптів і медіа. Це особливо важливо після внесення змін.

Робити запит на повторне сканування

Якщо сторінка оновлена або створена нещодавно, можна подати запит на повторний crawl. Водночас важливо враховувати, що це не гарантує миттєву індексацію, процес може зайняти час.

Переглядати звіт Crawl Stats

Цей розділ показує загальну динаміку сканування: кількість запитів, обсяг завантажених даних і час відповіді сервера. Так можна виявити технічні проблеми або різкі зміни в поведінці Googlebot.

Використовувати дані серверних логів

Для глибшого аналізу варто звертатися до логів сервера, де видно реальні запити Googlebot. Це допомагає зрозуміти, які сторінки скануються найчастіше, а які ігноруються.

У комплексі ці інструменти дають повне уявлення про те, як Google взаємодіє із сайтом: від першого обходу до потрапляння сторінки в індекс і її подальшого відображення в пошуку.

Як бізнесу використати це на практиці

Стратегія має бути простою і структурованою:

- важливі сторінки не слід блокувати в robots.txt, якщо вони мають працювати в пошуку, інакше Google не зможе їх просканувати, що ускладнить індексацію та оновлення контенту;

- якщо сторінку потрібно прибрати з видачі, для цього використовують noindex або обмеження доступу, адже robots.txt лише забороняє сканування, але не гарантує, що сторінка не з’явиться в пошуку;

- мобільна версія має бути повноцінною, а не спрощеною до втрати змісту — саме вона використовується для індексації, тому відсутність контенту або елементів впливає на оцінку сторінки;

- sitemap потрібно підтримувати в актуальному стані, тому що він допомагає Google швидше знаходити нові та оновлені сторінки, особливо на великих сайтах;

- Search Console варто перевіряти регулярно, а не лише після падіння трафіку; це дозволяє вчасно помічати проблеми зі скануванням, індексацією та технічним станом сайту.

Отже власники бізнесу мають пам’ятати: чим менше технічного шуму і чим чіткіше побудована логіка сайту, тим стабільніше він сканується, швидше оновлюється в індексі та надійніше зберігає органічну видимість.

27/04/2026

27/04/2026  1009

1009